Wer kennt das nicht? Egal, wo man anrufen will, bei Onlineshops, Mobilfunkanbietern, Banken, Versicherungen – man landet bei einem Callcenter. Da gibt es, bevor man überhaupt zu einem menschlichen Mitarbeiter durchgestellt wird, erst lästige Abfragen von einem Computer, wieso man anruft, dann hängt man ewig in der Warteschleife und hat schließlich einen genervten Callcenter-Mitarbeiter anderen Ende, der absolut kein Verständnis dafür hat, dass man nicht gerade bestens gelaunt ist und am Ende nicht einmal weiterhelfen kann, weil er wieder mal absolut keine Ahnung hat. Die Kompetenz und Professionalität der für telefonische Hotlines eingesetzten Service-Agenten beeinflusst aber in hohem Maße die Kundenzufriedenheit. Im fünften und letzten Teil unserer Serie über intelligente Spracherkennung beschäftigen wir uns heute damit, wie diese Technologie die Situation sowohl für Kunden als auch für die Mitarbeiter im Callcenter verbessern kann.

„Aktuell werden die Anrufe, welcher Agent welchen Anruf bekommt, per Zufall zugeteilt“, sagt Dagmar Schuller, CEO und Mitgründerin des Münchner Startups audEERING. „Auf der anderen Seite habe ich einen Kunden der in 99% der Fälle nicht anruft, weil er sich für irgendetwas bedanken möchte oder dem Call-Center-Mitarbeiter einfach einen schönen Tag wünschen möchte. Meistens sind das Leute, denen gerade ein Unfall passiert ist, bei denen die Katze die Ming Vase runtergeworfen hat, bei denen die Fensterscheibe zu Bruch gegangen ist oder Leute, die sich über ihre Abrechnung geärgert haben, die vielleicht falsch ist. Das heißt, sie sind sowieso schon gestresst und wahrscheinlich emotional in keinem tollen Zustand.“

Wenn dann im Callcenter auch noch ein ebenso gestresster Agent sitzt, sind Probleme vorprogrammiert. Um die Servicequalität zu verbessern, müssen Callcenter-Agenten also individuell geschult werden – nicht nur fachlich, sondern vor allem auch bezüglich ihres allgemeinen Auftretens gegenüber Kunden. Das geschieht auf der Basis ausgewerteter Anrufe, die aufgezeichnet werden. Dabei sind natürlich Sprach-, Stimm- und Emotionserkennung essentiell und hier kommt die intelligente Spracherkennung ins Spiel.

Weniger Stress auf beiden Seiten

„Unsere Software heißt Callyser und sie eröffnet zum Beispiel die Möglichkeit, Gespräche im Nachgang zu analysieren und neue Kennzahlen für das Callcenter zu schaffen“, erklärt Dagmar Schuller. Momentan würden Auswertungen meist nur nach jeweiliger Dauer und Anzahl der Gespräche eines Agenten geschehen. „Das wird dem Agenten aber nicht wirklich gerecht, denn wenn ich einen Agenten habe, der vielleicht pro Tag weniger Gespräche hat, aber einer ist, der einen negativen Kunden zu einem positiven wandeln kann, weil er einfach gut zuhört oder sich gut artikuliert oder dem Kunden ein gutes Gefühl vermittelt, ist der viel mehr wert als einer, der 20 Gespräche mehr hat, das aber nicht schafft.“

Die neue Software, die aktuell bei einem großen deutschen und einem schweizerischen Unternehmen als Beta-Version im Testeinsatz ist, eröffnet aber Möglichkeiten, neue Arten von Kennzahlen zu entwickeln. Man kann feststellen, „in welchem Zustand der Kunde reinkommt, was einen guten Agenten ausmacht, der das tatsächlich drehen kann. Außerdem hat man noch viel mehr Möglichkeiten festzustellen, wie die Gesprächsverläufe sind. Wenn ich das System in Echtzeit einsetze, habe ich sogar die Möglichkeit zu intervenieren, das heißt, frühzeitig zu erkennen, ob das Gespräch weiter ins Negative abrutscht und gegebenenfalls den Supervisor einschalten, der übernimmt, weil er erfahrener ist.“

Andererseits könnte das System dem Agenten vorschlagen, dem Kunden einen Gutschein anzubieten, um ihn zu besänftigen und der Agent müsste sich später nicht vor seinem Vorgesetzten rechtfertigen, da das neutrale System ihm diesen Schritt angeraten habe. „Man muss auch an den Agenten denken, der permanent solche Gespräche hat. Irgendwann stumpft der ab und hört nach dem siebten oder achten Gespräch vielleicht gar nicht mehr, wie verzweifelt der Anrufer anderen Ende der Leitung ist. Es geht aber darum, den, der anruft glücklich zu machen und ihm zu helfen, das Problem zu lösen“, erklärt Schuller, denn es ist viel kostenintensiver, einen neuen Kunden zu gewinnen als einen alten zu behalten. „Und jeder Kunde ist anders. Der eine ist sehr emotional, der andere ist weniger emotional. Sich auf auf den jeweiligen Kunden einzustimmen und das dementsprechend rauszuhören, hört nach dem vierten, fünften oder sechsten Gespräch irgendwann auf. Die Callcenter Analysen, die wir machen, zeigen zum Beispiel, wie lange das Gespräch ist, wie oft einer dem anderen ins Wort gefallen ist, wie sich der gesamte emotionale Verlauf dargestellt hat, um die Möglichkeit zu geben, frühzeitig zu intervenieren, den Kunden glücklich zu machen und den Agenten auf der anderen Seite auch stresstechnisch zu entlasten.“ Somit ist beiden Seiten geholfen, dem Kunden und auch dem Agenten.

Intelligentes Routing

Möglich wäre sogar noch ein weiterer Schritt. Die Rede ist hier von intelligentem Routing, das dank der Technologie, die nur zwei oder drei Sekunden braucht, um auszuwerten, wie eine Stimme klingt, für Anrufer und Agenten eine große Erleichterung darstellen könnte. „Sie hört nicht nur, wie jemand gelaunt ist, sondern auch, ob der männlich oder weiblich ist, wie alt und wo er ungefähr herkommt. Das System macht dann kein Zufallsrouting zu irgendeinem Agenten, sondern sucht der Analyse entsprechend einen raus, der im ähnlichen Alter ist, vielleicht sogar das gleiche Geschlecht hat, aus der gleichen Gegend kommt und daher den gleichen Akzent hat.“

Das heißt, wenn jemand aus Bayern anruft, wird der nicht zu einem Agenten aus Dresden durchgestellt, denn die Chance, dass sich jemand verstanden fühlt, wenn er mit einem „Landsmann“ redet, ist ungleich höher als wenn er mit jemand redet, der zum Beispiel Sächsisch spricht. Und es geht noch weiter. „Wenn ich dann noch weiß, das ist ein Agent, der hatte heute bereits sieben stressige Gespräche und ich gebe ihn jetzt noch das achte, dann ist der morgen wahrscheinlich krank. Also gebe ich es lieber dem, der erst zwei stressige Gespräche hatte“, erklärt Dagmar Schuller. „Die ganze Intelligenz der Maschine im Hintergrund kann genutzt werden, um beide Seiten zu optimieren. Das kann helfen, Krankenstände zu und Stresslevel zu reduzieren, Feedback zu bekommen und Coaching für die Agenten an die Hand geben – und zwar nicht nur einmal in sechs Monaten, sondern permanent. Dann fühlt sich sowohl der Kunde besser als auch der Agent und ich habe viel gewonnen.“

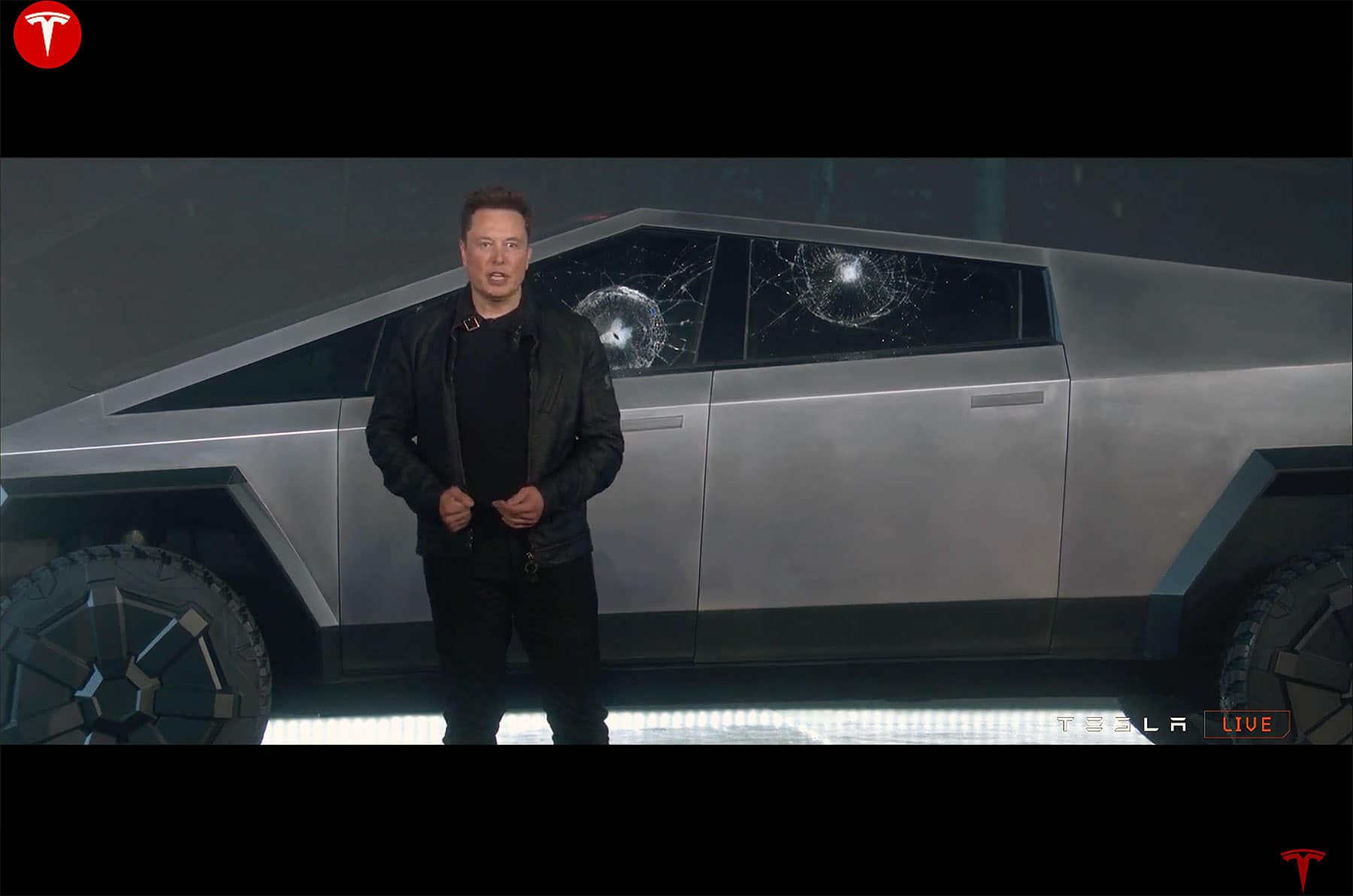

Langfristig gedacht könnte es sogar passieren, dass in einem Callcenter gar keine menschlichen Agenten mehr sitzen, weil es sich, vor allem bei Low-Preis-Produkten nicht rechnet. „Dann kann ich auch meinem Bot die Intelligenz geben, dass der tatsächlich die Emotionszustände erkennt und – ebenso wie der K.I.T.T. in der Serie Knight Rider – im Fahrzeug intelligent antworten und sich rückversichern kann, ob er alles richtig verstanden hat“, prophezeit Schuller. Dieses Szenario ist nicht nur Zukunftsmusik sondern absehbar. „Wir reden nicht von in zehn Jahren, wir reden eher von einem Zeitraum von drei bis fünf Jahren. Technisch sind wir soweit, dass wir das liefern könnten.“

Bei Text-to-Speech-Systemen wie Google WaveNet funktioniert Sprachsynthese heute bereits ganz passabel, selbst wenn alles noch etwas abgehackt klingt. Aber die Forschung geht weiter und bei den sogenannten Wave-GANs (Generative Adversarial Networks) werden zwei neuronale Netze miteinander verbunden, „die miteinander spielen und bei denen es einen Diskriminator und einen Generator gibt. Der Diskriminator muss immer unterscheiden zwischen echten und falschen Daten, schickt sie dann an den Generator zurück, der dann immer wieder neue Daten produziert, solange, bis Diskriminator zwischen echt und falsch nicht mehr unterscheiden kann. Diese Technologie wird in der Sprachsynthese jetzt eingesetzt, um neue Sprache aus einem Sprecher zu generieren, bei dem keine menschliche Sprache mehr enthalten ist.“

Eine solche Sprachsynthese werde bereits in den kommenden drei Jahren auf uns zukommen, glaubt Dagmar Schuller. „Das gibt uns die Möglichkeit geben, das auch mit einer Emotionskomponente zu versehen, sodass man tatsächlich mit der Maschine so kommunizieren kann, als würde man mit einem Menschen sprechen, der einen versteht.“ Für die menschliche Seite liege sogar ein großer Vorteil darin, mit einer neutralen Maschine zu kommunizieren, meint sie, da man in einem Mensch-zu-Mensch-Gespräch automatisch immer versuche auszuloten, wie der andere gerade gelaunt ist. „Das Problem hat man dann nicht. Man kann direkt sagen, ‚das nervt mich jetzt, dass ich bei dir rausgekommen bin, ich habe mit dem Produkt wahnsinnige Probleme, da steht drauf in Minuten aufgebaut und ich baue seit einem halben Tag meinen blöden Schrank auf. Hilf mir.‛ Der intelligente Bot sagt dann, ‚sei nicht so genervt, ich verstehe dich das hatte ich das letzte Mal auch‛, und der Kunde lacht und die Stimmung ist schon besser. Bis dahin fehlt nicht mehr sehr viel.“

Fotos und Grafik: audEERING, Pixabay (Titelbild)

Zum Thema:

Werden „Pepper“ oder „Paul“ dank intelligenter Sprachanalyse zu Superverkäufern?

Wie emotional und glaubwürdig sind Donald Trump und andere Politiker?

Ein Auto wie K.I.T.T. aus Knight Rider bald für Jedermann?

Mit intelligenter Spracherkennung gegen Depressionen und Selbstmorde

Münchner Startup auf den Spuren von Star Trek