Die Europäische Kommission will eine Liste für extrem risikoreiche Anwendungen der künstlichen Intelligenz (KI) erstellen. Zum Beispiel solche, die in der medizinischen Versorgung oder in selbstfahrenden Autos verwendet werden, die eine Sicherheitsprüfung bestehen müssen, bevor sie auf den Markt kommen dürfen. Das ist im sogenannten Weißbuch über künstliche Intelligenz „A European approach to excellence and trust“ (Ein europäischer Ansatz für Spitzenleistungen und Vertrauen) dargelegt, das die Europäische Kommission letzte Woche veröffentlicht hat.

Der Grund dafür ist, dass es derzeit nicht klar ist, wer für falsche Entscheidungen verantwortlich ist, die KI selbständig trifft, wenn es zu Unfällen kommt. Deshalb will die Europäische Kommission im Voraus klären, wie eine KI Entscheidungen trifft. Die Europäische Kommission will auch nachvollziehen können, wie die KI trainiert wird. Darüber hinaus, wie die KI Daten sammelt, was die KI damit macht. Und auch, in welchem Umfang und für welche Parteien diese Daten zugänglich sind.

Zu viel Arbeit für KMUs

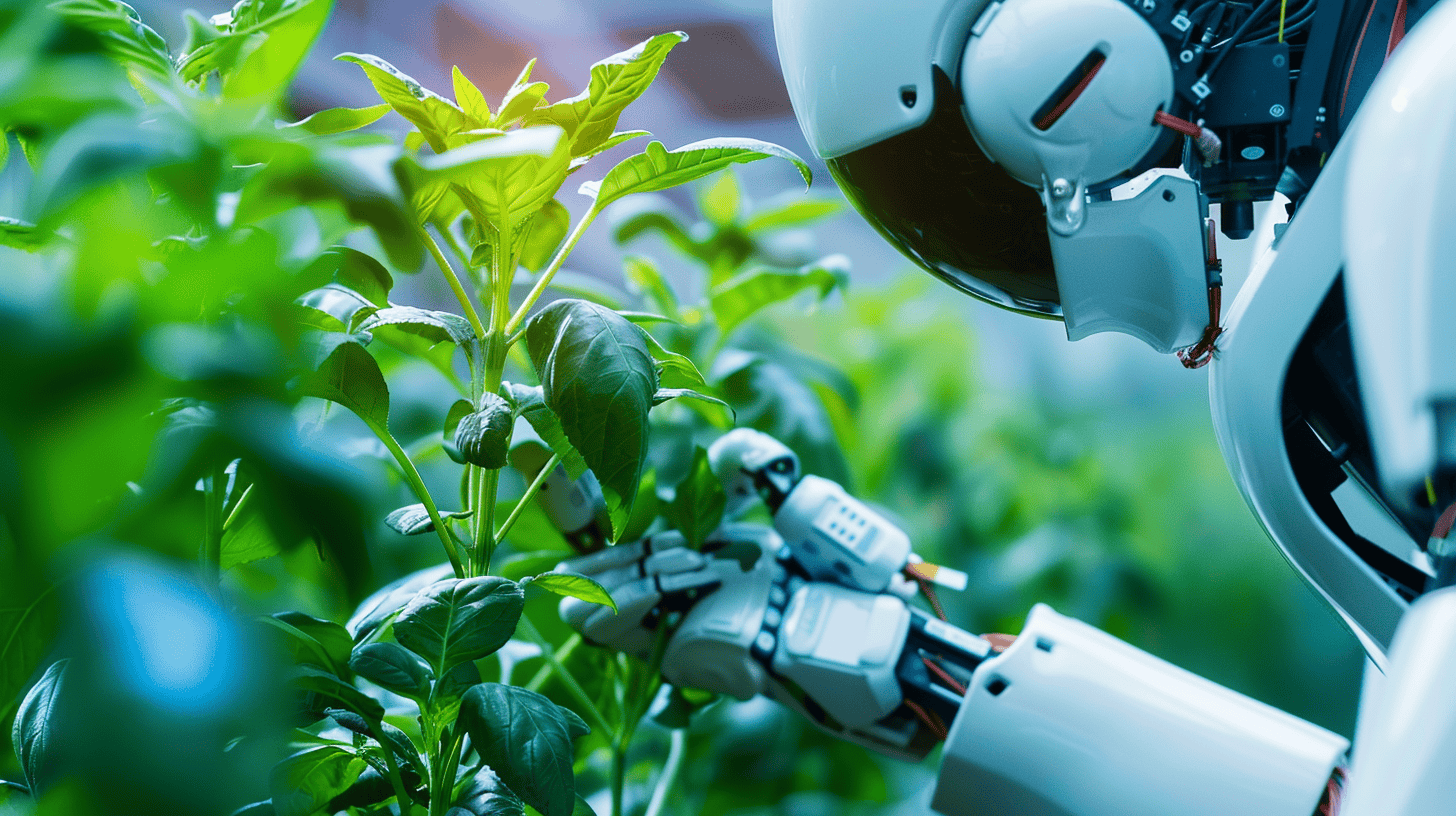

Im Weißbuch heißt es, dass es die Möglichkeiten der KMUs übersteigt, alle KI, die entwickelt wurden, durch die Mühlen der Sicherheit zu bringen. Und in einigen Bereichen ist es nicht einmal notwendig, weil es nur wenige vorhersehbare Risiken gibt. Stellen Sie sich zum Beispiel vor, dass ein kleines Unternehmen einen Planungsroboter herstellt, der die Lehrer für einen Stundenplan einer Realschule einteilt.

Wenn der Roboter eine falsche Einschätzung trifft, indem er beispielsweise zu viele komplizierte Fächer nacheinander für eine bestimmte Klasse anordnet und auch einfache Stunden wie Sport, Musik und Zeichnen nacheinander anordnet, ist das keine Katastrophe. Die Schule kann das leicht ändern, ohne dass Schüler oder Lehrer Schaden nehmen. Diese Art von KI sollte nicht auf Sicherheitsrisiken überprüft werden müssen, bevor der Hersteller sie verkauft.

Lesen Sie auch: EU-Kommissar Vestager wird 2020 eine neue KI-Gesetzgebung vorlegen

Wenn aber die KI eines selbstfahrenden Autos während der Fahrt die falsche Entscheidung trifft – oder die KI medizinischer Geräte während der Operation nicht die richtige Entscheidung trifft – und am Ende jemand stirbt, dann ist nach Ansicht der Autoren des Weißbuchs nicht klar, von wem man eine Entschädigung fordern kann. Schließlich ist es die KI, die eine Entscheidung trifft, nicht der Erfinder der KI.

Risikobereiche Gesundheitswesen und Verkehr

Daher wird für die Entwicklung und Anwendung der KI in Bereichen, in denen potenzielle Risiken bestehen, wie z.B. in der Transportindustrie und im Gesundheitswesen, eine Liste von Kategorien erstellt, die überwacht werden müssen. Diese wird regelmäßig überprüft werden. Auch die in diesen Kategorien auf den Markt gebrachte KI selbst wird regelmäßig überprüft werden müssen, da sie häufig aktualisiert wird.

Das Weißbuch befasst sich mit vielen Aspekten der KI, die derzeit nicht geregelt sind. Zum einen besteht ein Mangel an Transparenz. Jemand, der durch die Funktionsweise einer künstlichen Intelligenz belästigt oder beeinträchtigt wird und dafür bei den Gerichten Rechtsmittel einlegen möchte, wird nur dann Beweise bekommen können, wenn der Eigentümer der künstlichen Intelligenz diese zur Verfügung stellt. Es gibt derzeit keine klaren Regelungen, mit denen die Bürger diese Informationen rechtlich absichern können. Das sollte in Zukunft der Fall sein. Alle Informationen, die für den Betrieb der KI – an dem manchmal mehrere Anbieter beteiligt sind – verwendet wurden, müssen erhalten bleiben.

Darüber hinaus ist unklar, wer genau für potenziell schädliche Auswirkungen der KI auf die Menschen verantwortlich ist. Der Entwickler stellt das Grundprodukt her, aber der Benutzer schult den Roboter auch nachträglich. Es muss auch klar werden, wie damit umgegangen werden soll.

Debatte um Gesichtserkennung

Ein Thema, das in der Europäischen Union problematisch ist, ist auch Gegenstand einer großen Debatte über die Anwendung von KI, die ferngesteuert biometrische Merkmale verwendet. Zum Beispiel die Gesichtserkennung. In dem Dokument heißt es, dass diese nur zulässig sei, wenn es einem bestimmten, entscheidenden Zweck, z.B. der Sicherheit, dient. Laut der Europäischen Kommission sollte die KI nicht dazu verwendet werden, um Bürger mit einer Kamera anhand ihres Gesichts zu identifizieren, die bei Rot über eine Straße gehen. Das geschieht in China. Dort wird ein Fußgänger, der eine Ampel ignoriert, automatisch mit einem Bußgeld belegt, wenn die KI-Kamera ihn identifiziert und den Verstoß aufzeichnet.

Lesen Sie auch: Europa muss in eine Drehscheibe für kollaborative Roboter in KMU investieren

Bereits die vorgeschlagenen rechtlichen Beschränkungen der Anwendung von KI wurden in verschiedenen Medien kritisiert, weil sie die Entwicklung der KI in der EU verzögern. Insbesondere im Vergleich zu den USA und China. Außerdem würde die Technologie immer noch in die EU gelangen, aber eher über chinesische als über europäische Unternehmen.

Neue europäische Gesetzgebung für KI in Vorbereitung

Dieses Weißbuch für die Entwicklung und Umsetzung der KI ist eigentlich ein Startdokument der Europäischen Kommission. Es dient als Grundlage für die Ausarbeitung eines Gesetzes oder einer Gesetzesänderung. Diese werden von den nationalen Regierungen, Parlamenten und dem Europäischen Parlament verabschiedet. (Noch ist nicht entschieden, welches von beiden es sein wird).

Wollen Sie mitreden?

Interessenvertreter sowie Verbraucherorganisationen, Universitäten und Unternehmen können der Europäischen Kommission Vorschläge unterbreiten. Sie haben bis zum 19. Mai Zeit, dies zu tun, um auf die vorgeschlagene Gesetzgebung bezüglich der KI einen gewissen Einfluss zu nehmen.