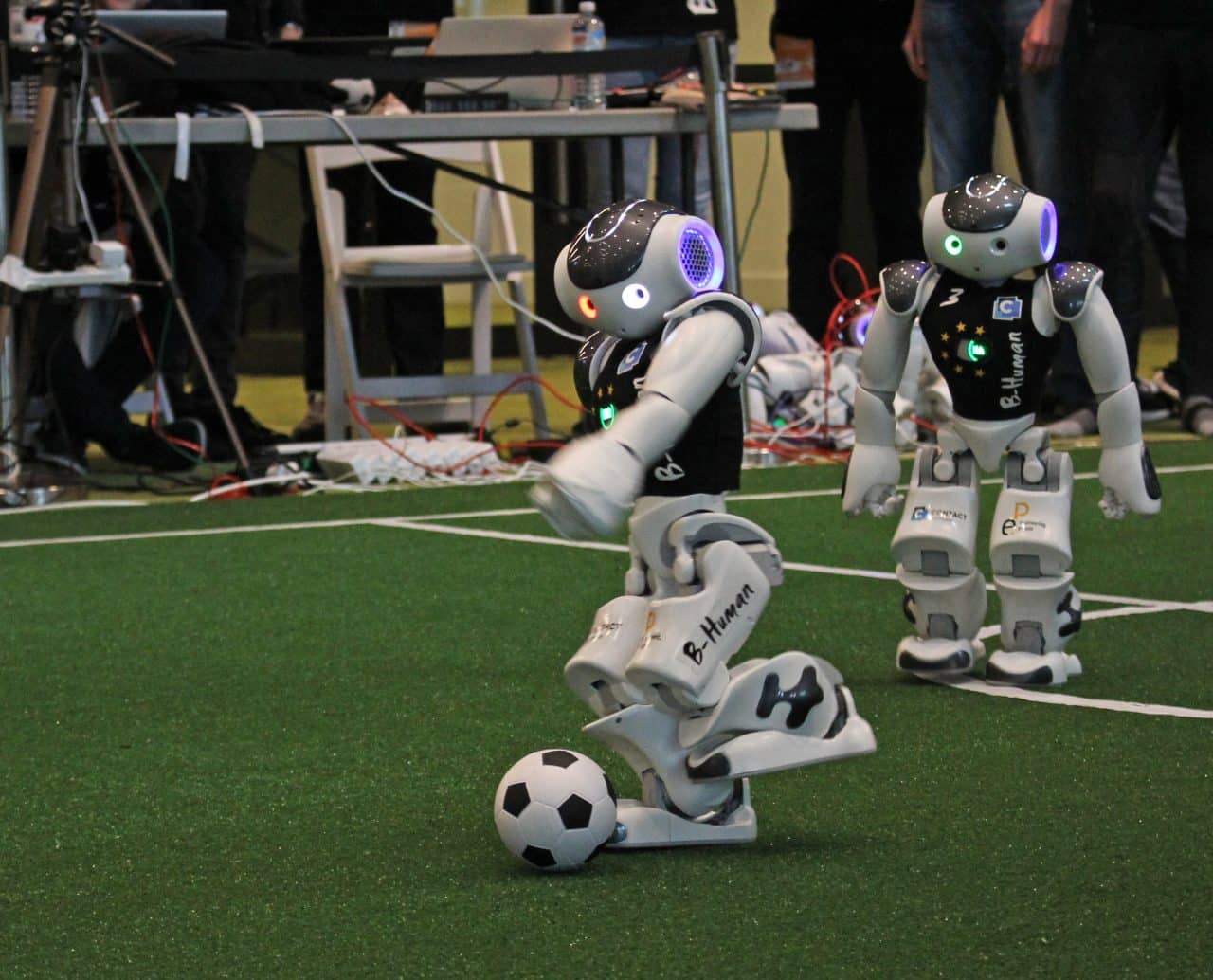

Drei Weltmeistertitel mehr als die deutsche Fußball-Nationalmannschaft der Herren und trotzdem drängten sich bei der Ankunft des Teams B-Human im Juli keine Menschenmassen am Bremer Flughafen. Roboter-Fußball hat es noch nicht in die Primetime der Fernsehsender weltweit geschafft. Obwohl hier Zukunftsweisendes programmiert und getestet wird. Ein Interview mit Tim Laue, einem der führenden Köpfe des amtierenden Weltmeisterteams, über die aktuellen Herausforderungen beim RoboCup, Dinge, bei denen Menschen immer noch viel besser sind als Roboter und was Robo-Fußball mit autonomen Fahrzeugen zu tun hat.

Wenn Sie die Bundesliga mit Roboter-Fußball vergleichen, worin besteht die derzeit größte Herausforderung für die Roboter?

Oh, da gibt es viele. Das fängt schon beim Laufen an. Menschliche Gelenke erreichen viel höhere Geschwindigkeiten. Vereinzelt kommen hochspezialisierte Industrieroboter, die sehr spezifische Dinge zusammenbauen, auf ein solches Niveau. Humanoide Roboter beherrschen heute zwar sehr viele Bewegungsabläufe. Unsere NAOs haben zum Beispiel sechs Elektromotoren pro Bein und entsprechend viele Freiheitsgrade. Aber Sie haben immer ein Energie- und Platzproblem. Die Extremitäten so fein und reaktiv zu bewegen wie ein Mensch, ist damit heute noch nicht möglich. Das bräuchten wir aber, um eine solche Maschine unfallfrei rennen oder richtig hart aufs Tor schießen zu lassen.

In Ihrer Spielklasse verwenden alle Teams denselben Robotertyp?

Beim RoboCup beteiligen wir uns an der sogenannten Standard Platform League. Hier verwenden alle den NAO von Softbank – circa 60 cm hoch, fünfeinhalb Kilo schwer. So gesehen ist das, was wir machen, ein Softwarewettbewerb auf Basis einer einheitlichen Hardware. Im Gegensatz dazu gibt es etwa die Humanoid-Adult-Size-League. Hier können die Roboter auch 1,50 m hoch sein und werden von den Teams selbst gebaut.

Entsprechend treten in den unterschiedlichen Wettbewerben auch Experten unterschiedlicher Disziplinen an?

In unserer Klasse sind es vor allem Informatiker, die sich da tummeln, in anderen oftmals auch Elektroingenieure oder Elektrotechniker. Innerhalb dieser Disziplinen ist der Roboterfußball in Deutschland allerdings nicht sehr populär.

Zufall?

Anfang der 2000er Jahre hat die Deutsche Forschungsgemeinschaft den Roboterfußball gezielt gefördert. Da gab es bundesweit ein gutes Dutzend Arbeitsgruppen, bestückt mit Wissenschaftlern, die Vollzeit dafür bezahlt wurden, Robotern das Fußballspielen beizubringen. Das hat die Sache auf breiter Front vorangebracht. Deutsche Teams wurden international erfolgreich. Aus meiner Sicht wirkt das bis heute nach.

Wie sieht es mit der Konkurrenz aus?

Die Teams, die beim RoboCup antreten, sind sehr unterschiedlich. Das Team aus Austin, Texas zum Beispiel, das sind alles Doktoranden mit abgeschlossenem Studium. Es gibt Hobbyteams oder solche, die sich auf Projektbasis zusammenfinden. Bei uns in Bremen ist das eine offizielle Lehrveranstaltung. Die Studierenden können hierfür vergleichsweise viele Creditpoints bekommen und investieren entsprechend viel Zeit. Das hilft.

Mal abgesehen von den Creditpoints, was haben die Studierenden davon?

Die gehen dann mit ihrer Erfahrung beispielsweise in Bereiche wie industrielle Bildverarbeitung oder arbeiten an autonom fahrenden Autos.

Das eine hat etwas mit dem anderen zu tun?

Was den RoboCup in meinen Augen ausmacht: Es ist eine Testumgebung für sehr komplexe Software. Die Rahmenbedingungen sind definiert, aber auf das, was die gegnerische Mannschaft macht, haben wir keinen Einfluss. Um diese Situation zu bewältigen, greifen wir auf einen umfangreichen Pool an Algorithmen zurück, erfinden neue dazu und prüfen dann unter harten Bedingungen, ob das im Zusammenspiel funktioniert.

Die Maschinen sind während des Spiels auf sich alleingestellt?

Vollkommen. Die fünf Spieler einer Mannschaft machen alles alleine. Das Programm, das auf den Robotern läuft, muss also die Situation – Spielfeld, eigene Position, die Position der Mit- und Gegenspieler, die Tore, den Ball – überhaupt erstmal erkennen und dann in allen Spielsituationen die richtigen Schlüsse ziehen.

Es gibt keine vorgegebenen Schrittfolgen, zum Beispiel eine zweier Abwehrkette und das synchrone Verschieben der Kette?

Man kann Schrittfolgen vorgeben, schon. Aber dann werden es unter realen Bedingungen vielleicht nur zweieinhalb Schritte nach vorn statt der geplanten drei oder bei der Drehung kommen vielleicht nur 80 Grad heraus, statt der geplanten 90.

Selbst einfache Bewegungen lassen sich mit einem solchen Roboter nicht präzise ausführen?

Es kann Abweichungen geben. Das muss der Roboter merken und die Drehung gegebenenfalls korrigieren. Viele tausend Zeilen Quellcode drehen sich zum Beispiel um die Frage, wo sich der Roboter genau aufhält.

Für den Mensch ist das trivial. Ich weiß sofort, wo ich mich auf dem Spielfeld befinde, wo die Tore sind etc. Unsere Roboter müssen sich zunächst einmal orientieren. Dazu haben sie zwei Videokameras, eine im Kinn, eine in der Stirn. Da kommen pro Sekunde 60 Kamerabilder an, die wir alle auswerten wollen. Das heißt, wir schauen auf jedem einzelnen Videobild, ob darauf eine Seitenlinie zu sehen ist, der Mittelkreis, der Elfmeterpunkt usw. Darüber berechnet der Roboter dann die eigene Position.

Die Maschinen nutzen kein GPS-Signal? Das läuft alles über die Videodaten, die auf dem Feld entstehen?

Genau.

Ihr Team hat jetzt sieben Mal den Weltmeistertitel geholt. Was können Ihre Roboter besser als die anderen?

Sie können im Mittel alles besser als die Gegenspieler. Oder besser umgekehrt ausgedrückt: Wenn sie nur eine der vielen Aufgaben nicht gut beherrschen würden – also etwa die Ballerkennung oder wenn sie häufiger umfallen würden als die Konkurrenten –, dann würde sich dieser Fehler über das Spiel hinweg zu einem mächtigen Nachteil multiplizieren und wir würden mit hoher Wahrscheinlichkeit verlieren. Robuste Algorithmen über alle Aufgabenfelder hinweg, das scheint unser wichtigster Wettbewerbsvorteil zu sein. – Einmal abgesehen davon, dass wir häufiger von anderen Teams dafür gelobt werden, dass unsere fünf besonders gut taktisch zusammenspielen.

Teamfähigkeit kann also auch beim Robo-Fußball spielentscheidend sein?

Auf jeden Fall. In diesem Jahr haben wir tatsächlich viele Pässe gespielt. Dafür muss sich der Mitspieler in eine Position bringen, in der er überhaupt anspielbar ist. Im Gegenzug muss der ballführende Spieler entscheiden, ob er selbst schießen soll, dribbeln oder passen. Das hat bei uns in vielen Fälle gut funktioniert.

Allerdings hatten wir auch einmal den Fall, dass der ballführende Roboter direkt vor dem gegnerischen Tor stand und statt einzuschießen, spielte er einen Pass zum Nebenmann.

Nach einem Spiel schauen Sie sich die Daten an und gehen die Verbesserung der Abläufe an?

Jeder Roboter zeichnet 60 Mal pro Sekunde alles auf, was passiert; die aufgenommenen Bilder, was erkannt wurde, welche Entscheidungen er getroffen hat usw. Das ergibt pro Roboter und Spiel mehrere Gigabyte Daten. Während des Spiels notieren wir die Zeiten, in denen etwas Dummes passiert und schauen später, was da los war.

Bleiben wir bei dem unsinnigen Pass. Woran lag‘s?

Im konkreten Fall hat die Berechnung ergeben, dass der direkte Weg zum Tor nicht frei war. Das kann daran liegen, dass der Roboter einen zweiten Gegner erkannt hat, der gar nicht da war. Sagen wir, er erkennt einen Gegenspieler, schaut weg, um den Ball zu orten, schaut wieder hin und erkennt einen zweiten Gegenspieler – der eigentlich der erste ist, der sich allerdings in der Zwischenzeit weiterbewegt hat. Dann ist plötzlich kein Platz mehr für einen Torschuss.

Sensortechnische Probleme?

Als Mensch baue ich mir eine mentale Karte von meinem Umfeld auf. Auch wenn der Ball an mir vorbei rollt und ich ihn nicht mehr sehe, habe ich trotzdem eine Vorstellung davon, wo der Ball liegt. Etwas Ähnliches machen die Roboter auch. Sie kalkulieren die eigene Bewegung und erinnern sich quasi daran, dass da etwas war, auch wenn sie es gerade nicht sehen. Je länger sie dann nicht hinschauen, desto grober ist die Schätzung über die Situation hinter ihnen. Dass die Roboter alle gleich aussehen, macht die Sache nicht einfacher.

Die Roboter senden kein Freund-Feind-Signal?

Es stehen Nummern drauf. Der menschliche Schiedsrichter kann die Nummern einfach erkennen. Theoretisch könnte auch unsere Software die Nummer nutzen. Aber praktisch ist das nicht so einfach und wir haben noch keine Arbeit hineingesteckt, um das zu können.

Sie kommunizieren untereinander?

Die Roboter können im Team per WLAN Daten austauschen. Jeder Teamroboter schickt einmal pro Sekunde die ermittelten Koordinaten an die Mitspieler; wo befinde ich mich, wo glaube ich, seid ihr, wo ist der Ball etc. Jeder Roboter baut dann seine eigene Karte der Spielsituation auf.

Ein wichtiges Thema beim Autonomen Fahren: Zu wissen, wo sind andere Verkehrsteilnehmer, wie sind die Umgebungsverhältnisse vor mir, wie schnell sind die anderen …

Jedes autonome Fahrzeug vermisst mit diversen Sensoren sein Umfeld und baut sich ein eigenes Konstrukt seiner unmittelbaren Umgebung auf. Sonst würde es sehr schnell sehr gefährlich.

Insofern ist das Spielfeld eine prima Testumgebung …

Wir haben bei den Robotern den Nachteil, dass viele Sensoren, die beim Auto zum Einsatz kommen, zu schwer wären. Die Kameras wiegen nur wenige Gramm. Je größer und schwerer der Roboter, desto höher der Energieverbrauch und die Kräfte, die wirken, wenn er hinfällt. Der humanoide Roboter braucht ja allein fürs Stehen schon Energie. Im Vergleich dazu ist der Mensch beeindruckend effizient.

Ist doch schön, dass Menschen zur Abwechslung auch einmal etwas besser können als ein Roboter.

Der Mensch ist nach vielen tausend Jahren Evolution schon ziemlich optimiert, sodass ich ein Gewicht von rund 80 Kilogramm ziemlich lange durch die Gegend bewegen kann, und das mit einer vergleichsweise geringen Energiezufuhr – ein bisschen Wasser und ein Brötchen, das reicht für viele Stunden. Davon sind heutige Roboter noch weit entfernt.

@Fotos: University of Bremen/Tim Laue

Im zweiten Teil des Interviews geht’s darum, wie Roboter ihre Umgebung detektieren und verarbeiten.