Nur ein universelles Gesetz über Verhaltensregeln für Roboter und den Einsatz künstlicher Intelligenz kann die Menschheit vor ihrem brutalen Missbrauch schützen, sagte Direktor Carlo van de Weijer vom Eindhoven AI Systems Institute (EAISI) beim Informationstag High Tech Next in der vergangenen Woche. Aber es bleibt abzuwarten, wie ein solches Gesetz auf den Weg gebracht werden kann.

Die logische Konsequenz ist, dass die Vereinten Nationen ein solches Gesetz erlassen. Das ist die einzige globale Regierungsstelle, die wir haben und die so etwas tun kann. „Es steht dort auch auf der Tagesordnung. Allerdings ist nicht jedes Land Mitglied der Vereinten Nationen”, sagte Van de Weijer. Wie kann dieses Problem also gelöst werden? Das weiß niemand wirklich.“

Wenn ein solches universelles Gesetz für KI zustande käme, wäre es ein „gigantischer Papierberg”, so Van de Weijer. „So dick wie eine Bibel.”

Drei Regeln für Roboter

In der Vergangenheit wurden von Zukunftsforscher und Science-Fiction-Autor Isaac Asimov drei Regeln aufgestellt, die auch heute noch in der Wissenschaft gelten. Die erste ist, dass ein Roboter den Menschen keinen Schaden zufügen darf und verhindern muss, dass Menschen verletzt werden. Die zweite Regel ist, dass der Roboter einem Menschen gehorchen muss, es sei denn, dies bringt ihn in Konflikt mit der ersten Regel. Die dritte Regel ist, dass der Roboter in der Lage sein muss, sich selbst zu schützen, außer wenn dies im Widerspruch zur ersten und zweiten Regel steht.

Obwohl diese Regeln sehr klar sind, werden sie nicht mehr von allen respektiert. „Meiner Meinung nach haben wir diesen Punkt bereits überschritten”, sagt Van de Weijer.

Drohnen, die schießen

Um der Öffentlichkeit zu veranschaulichen, was passieren kann, wenn Menschen KI nutzen, zeigte Van de Weijer You Tube-Videos. Zum Beispiel Drohnen, die Gesichtserkennung nutzen, um jemand zu töten. Der Clip war fiktiv, aber trotzdem war er nicht gerade etwas, worüber man sich begeistern sollte.

In einem weiteren Video zeigte er, wie Menschen von einem selbstfahrenden Auto mit Kameras profitieren können, die kontinuierlich filmen, was in der Umgebung passiert. Man stelle sich vor, Google würde in Zukunft Eigentümer von 1% dieser Art von Autos werden, dann hätten sie einen enormen Stand auf dem Informationsmarkt, sagte Van de Weijer.

Lesen Sie hier weitere Kolumnen von Carlo van de Weijer bei Innovation Origins.

Das liegt an all den Daten, die die Autos auf der Straße und auf ihren Parkplätzen sammeln. Sie sind eine Menge Geld wert und sie können das verkaufen.

Privatsphäre an einen Automobilhersteller verkaufen

Der Nachteil dabei ist, dass Passagiere und Autofahrer auf diese Weise ihre Privatsphäre verlieren. Das gilt auch für Personen, die in der Nähe des Autos sind. Sie werden auch ohne ihre Erlaubnis gefilmt und haben wahrscheinlich keine Ahnung, dass es passiert.

Bisher war diese Art Auto für Endverbraucher noch nicht auf dem Markt. Es ist jedoch nicht auszuschließen, dass sie in Zukunft eingeführt werden. Theoretisch ist ein Modell denkbar, bei dem die Verbraucher ein Auto „kostenlos” fahren können, wenn sie im Gegenzug ihren Daten preisgeben, sagte Van de Weijer. Kostenlos steht in Anführungszeichen, weil es nicht wirklich kostenlos ist. Schließlich verkaufen die Verbraucher, die ein solches Angebot annehmen, ihre Privatsphäre.

Wer überwacht die Roboter?

Van de Weijer sieht für die KI-Industrie in Eindhoven im Bereich der menschenfreundlichen KI und Robotik eine führende Rolle voraus. Dafür besteht nicht nur großer Bedarf, es gibt auch viel Spielraum dafür.

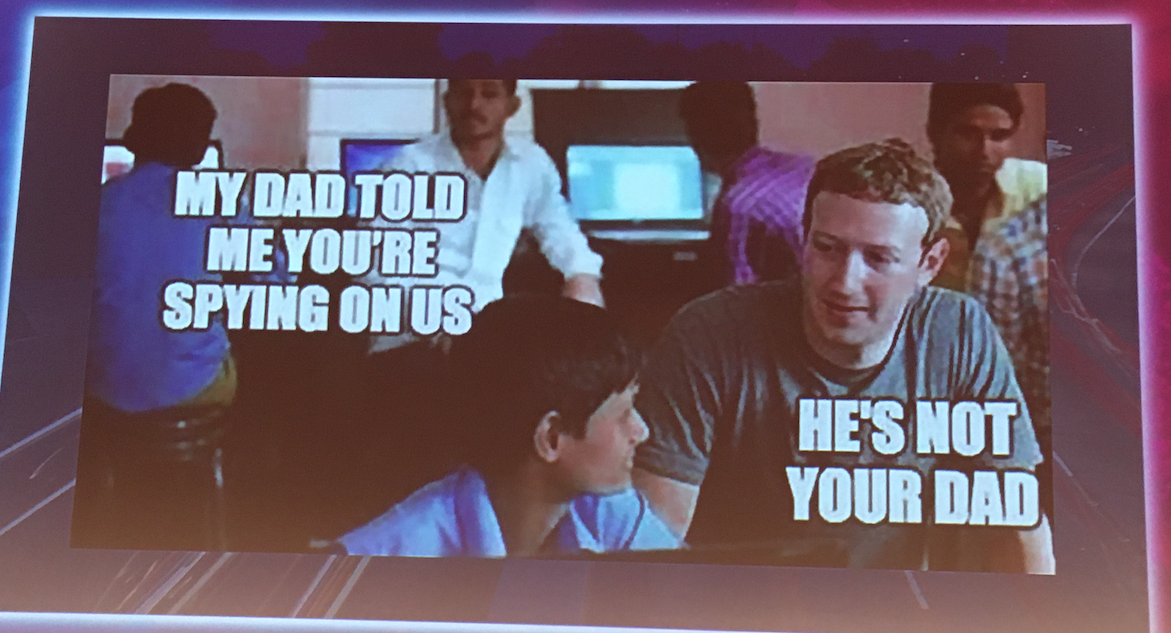

Die Supermächte China und USA investieren in der Tat viel Geld in die Entwicklung neuer KI, sagte Van de Weijer. Aber wie diese KI genutzt wird, wird von der chinesischen Regierung von oben nach unten festgelegt. Sie stellen im Allgemeinen keine Regeln auf, die dem Rest der Welt zugute kommen. In den USA bestimmt der Markt – z.B. Google und Facebook -, wie KI genutzt wird. Diese Unternehmen wollen generell aus Verbraucherdaten Kapital zu schlagen. Das bedeutet, dass ihre Interessen nicht immer vor Missbrauch geschützt sind.

In Eindhoven könnten Regeln für den verantwortungsvollen Umgang mit KI ausgearbeitet werden, die als Beispiel für den Rest der Welt dienen könnten.