Van de kromming van komkommers tot de grootte van vissticks, geen aspect van het leven is te klein of onbeduidend om aan de waakzame blik van Brussel te ontsnappen. Het is dan ook geen verrassing dat de EU nu haar aandacht richt op de wereld van de kunstmatige intelligentie. Jawel, de EU heeft een reeks ontwerpverordeningen over AI (Artificial Intelligence) vrijgegeven.

De bovenstaande zinnen zijn niet door mij geschreven, maar zijn het werk van een kunstmatige intelligentie. Ze zijn geschreven door ChatGPT, een taalmodel gebouwd door het onderzoekslaboratorium en bedrijf OpenAI. De AI werd gevoed met grote hoeveelheden tekst, geïnstrueerd om de patronen ervan te identificeren, en vervolgens getraind om plausibele originele antwoorden op prompts te produceren. In dit geval gaf ik ChatGPT de opdracht “een grappig artikel te schrijven over EU-plannen om AI te reguleren”.

Dagelijks leven

Kunstmatige intelligentie maakt al deel uit van ons dagelijks leven. We communiceren met chatbots van de klantenservice, gebruiken automatische vertalingen en selecteren automatisch gegenereerde antwoorden in e-mail en messaging-apps die raden hoe we onze zinnen willen afmaken.

AI is aan het werk wanneer Google resultaten voor ons kiest op basis van zijn gissingen over wat we zoeken en wordt al gebruikt om ongekwalificeerde kandidaten uit te filteren bij de eerste sollicitatierondes.

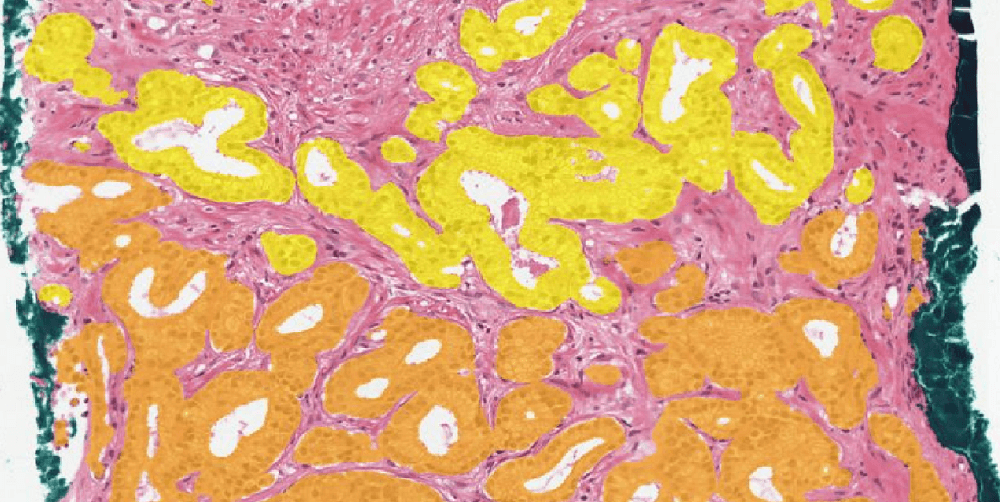

Boeren kunnen AI gebruiken om gewassen te monitoren en waar nodig kunstmest of water toe te dienen, of om autonoom vee te voeren. Computerprogrammeurs gebruiken automatisch gegenereerde code om hun werk te versnellen. AI’s worden getraind om tumoren op te sporen in scanresultaten, met als doel artsen te helpen bij de diagnose van kanker.

Er zijn waarschijnlijk nog veel meer toepassingen van AI die we ons nog niet kunnen voorstellen. Verwacht wordt dat de technologie de manier waarop veel banen worden uitgevoerd zal veranderen, en misschien de meer formele vormen van schrijven zal overnemen, zoals in de eerste zinnen van dit artikel alvast wordt aangetoond.

De opmars van deze technologie roept interessante ethische vragen op, en een dilemma over hoe een en ander te reguleren.

Er is de kwestie van aansprakelijkheid. AI-systemen kunnen autonoom handelen, dus als ze een fout maken, wie is er dan verantwoordelijk? De risico’s zijn aanzienlijk, of het nu gaat om een verkeerde diagnose, oneerlijke discriminatie in een sollicitatieprocedure of een zelfrijdend voertuig dat een ongeluk veroorzaakt.

Bevooroordeeld

AI’s kunnen bevooroordeeld zijn door de informatie waarmee ze worden gevoed. De zinnen waarmee dit artikel begon dienen als goed voorbeeld. Ze geven aan dat ChatGPT heeft geleerd van de Boris Johnson-stijl van Engelstalige berichtgeving over de EU, waarin vermeende plannen voor de kleinzielige regulering van levensmiddelen door een nevelig “Brussel” worden overdreven of verzonnen.

Een AI trainen op basis van vroegere sollicitaties zou hem kunnen leren te discrimineren op basis van geslacht of etniciteit. Vanwege de datasets die bij de ontwikkeling ervan zijn gebruikt, kan AI voor gezichtsherkenning minder goed werken voor zwarte mensen, waardoor zij worden benadeeld wanneer dergelijke systemen worden gebruikt om de identiteit te verifiëren, zoals nu al gebeurt bij online bankieren en bij de toegang tot sommige sociale diensten.

Verzekeringsmaatschappijen zouden een AI kunnen gebruiken om mensen met bepaalde levensstijlen of medische familiegeschiedenissen uit te sluiten van dekking, wat tot onrechtvaardige uitkomsten leidt. Er zijn ook zorgen over de privacy in verband met het gebruik van gegevens om de AI’s te trainen.

Uiteindelijk kunnen kunstmatige intelligentiesystemen enorm krachtig worden. Ten gunste van wie?

Science Fiction

Momenteel worden ze ontwikkeld door ‘s werelds rijkste technologiebedrijven, en dus kan worden verwacht dat ze deze reeds machtige particuliere belangen zullen bevorderen, dat ze worden ontworpen op een manier die cultureel gezien gericht is op de Verenigde Staten, en dat ze de ongelijkheid verder zullen verankeren.

Het klinkt misschien als science fiction, maar er bestaat grote bezorgdheid over de vraag of een kunstmatige intelligentie uiteindelijk tegen de belangen van de mensheid zou kunnen werken. Repressieve regeringen gebruiken al AI’s (gevoed door de massale verzameling van gegevens van de bevolking) als een manier om voordelen toe te kennen of te onthouden.

AI’s kunnen zich met enige autonomie gedragen, dus een AI met toegang tot het internet zou zichzelf kunnen trainen tot het meest effectieve oplichtersnetwerk ooit, door oneindig veel phishing-, losgeld- of romance-zwendelpraktijken tegelijkertijd uit te voeren, en van elke ervaring te leren om bij de volgende effectiever te zijn. Een AI zou zelfs een nieuw systeem van kunstmatige intelligentie kunnen bouwen om nog een ander doel te dienen.

AI Act

De poging van de EU om met deze opkomende brave new world om te gaan heet de AI Act. Als early-mover regelgeving die van toepassing zou zijn op 450 miljoen van ‘s werelds rijkste mensen, zal deze waarschijnlijk wereldwijde invloed hebben.

De door de Europese Commissie voorgestelde ontwerpwet heeft een op risico’s gebaseerde aanpak. AI’s met een “onaanvaardbaar risico”, zoals het sociale scoresysteem dat door de Chinese overheid wordt gebruikt, worden volledig verboden. Systemen met een “hoog risico”, zoals die welke worden gebruikt in het vervoer, het onderwijs, de rechtshandhaving of bij aanwerving, moeten risico’s beperken en menselijk toezicht inbouwen. Voor systemen met een “minimaal” of “beperkt” risico, zoals chatbots, spamfilters of videospelletjes, gelden minder strenge regels.

De wetgeving heeft zich tijdens de onderhandelingen verder ontwikkeld en de 27 EU-lidstaten hebben onlangs onderling een compromis gesloten. Volgens het nieuwe ontwerp zouden militaire, defensie- en nationale veiligheids-AI’s niet onder de verordening vallen. Ook zou de politie in uitzonderlijke omstandigheden biometrische bewaking op afstand in openbare ruimten mogen gebruiken, zoals het scannen van gezichten om verdachten op te sporen. De onderhandelingen met het Europees Parlement komen eraan.

Sommige maatschappelijke organisaties hebben gewaarschuwd dat de waarborgen van deze wetgeving te zwak zijn. Het is duidelijk dat de regeringen van de EU niet willen dat inspanningen om de risico’s van kunstmatige intelligentie te verminderen hen beroven van de potentiële mogelijkheden van de technologie, of de innovatie stilleggen in een industrie die velen zien als veelbelovend voor economische groei.

Bovenstaand artikel werd eerder gepubliceerd in de Irish Times.