De afgelopen twaalf maanden gaan de boeken in als het tijdperk van de realisatie van AI. Het grote publiek kwam erachter waar AI allemaal toe in staat is: de opsporing van kanker verbeteren, duizenden jaren oude papyri ontcijferen of de stem van John Lennon recreëren. Het belangrijkste is dat de meeste mensen zich bewust werden van het potentieel van AI om elk terrein van de samenleving te betreden. De potentiële risico’s van AI kwamen echter ook aan het licht.

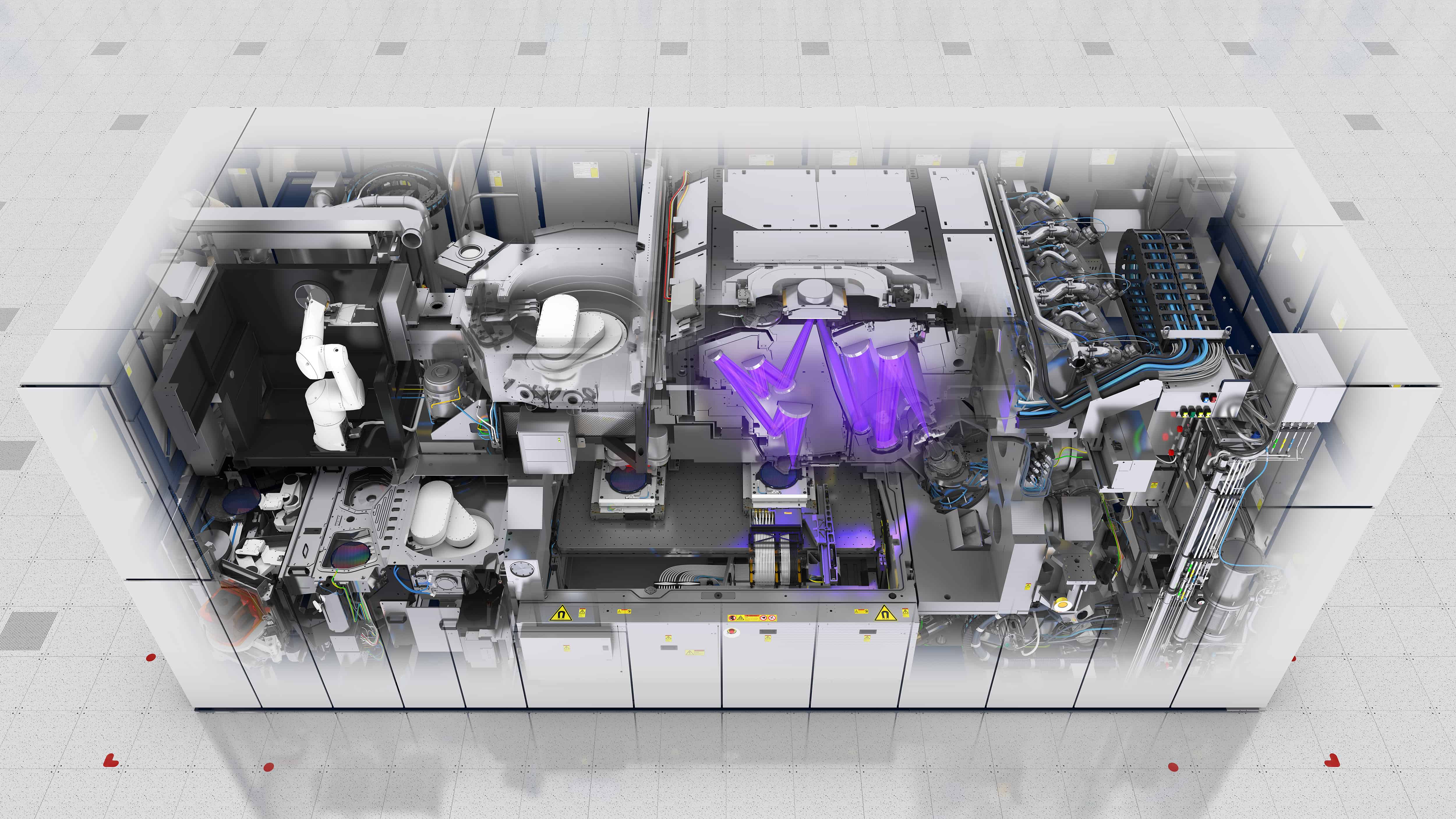

- AI ontpopt zich als een horizontale technologie met het potentieel om elke sector te ontwrichten.

- Mensen erover voorlichten is daarom van fundamenteel belang om vertrouwen en bewustzijn te creëren.

- Nu de regelgeving begint te worden geïmplementeerd, ligt er nog veel werk voor de boeg.

In een poging om AI te beschermen tegen bedreigingen en de ontwikkeling ervan te reguleren, beginnen overheden met het opstellen van wet- en regelgeving. Eind oktober kondigde president Joe Biden van de Verenigde Staten nieuwe normen voor AI-beveiliging aan. Ontwikkelaars worden verplicht om resultaten van hun veiligheidstests te delen met de Amerikaanse overheid, ontwikkelen nieuwe tools om de betrouwbaarheid van AI-systemen te garanderen en de VS lanceerde maatregelen om de privacy van Amerikanen te beschermen De EU reguleert de AI-ruimte ook met de AI Act.

Reggie Townsend is vicepresident data-ethiek bij SAS, een wereldwijde leider in AI- en analysesoftware, en lid van het National Artificial Intelligence Advisory Committee (NAIAC). Dit comité adviseert de Amerikaanse president over AI. Hij is ook bestuurslid van EqualAI, een non-profitorganisatie die bias in AI wil terugdringen. Townsend is ingenieur van opleiding en technoloog in hart en nieren en heeft er altijd van genoten om te leren over opkomende technologieën. Zodra hij bekend raakte met AI, werd zijn nieuwsgierigheid deels bezorgdheid en vond hij het noodzakelijk actie te ondernemen. Hij is ervan overtuigd dat mensen voorlichten over AI cruciaal is en dat het kan helpen misvattingen uit de wereld te helpen.

Dit is een artikel uit IO Next: The year of… Voor het laatste magazine van dit jaar hebben we de artikelen geselecteerd die ons het meest zijn bijgebleven, of het nu een indrukwekkend interview, een belangrijk verhaal of gewoon iets grappigs was.

Waarom Mauro dit verhaal selecteerde voor het magazine:

In veel opzichten was 2023 het jaar van AI. Van het algemene publieke besef van de mogelijkheden tot de implementatie van de eerste regelgeving, 2023 zal worden herinnerd als een cruciaal jaar in de geschiedenis van AI. Welke impact kunnen we de komende jaren verwachten van AI? Hoe kunnen we de risico’s beperken? Om het jaar af te sluiten, hadden we een interview met Reggie Townsend, een van de experts in de commissie die de Amerikaanse president adviseert over AI.

Wat is de grootste misvatting over AI?

“Ik denk dat veel mensen een Terminator-visie hebben op AI. De media schrijven over veel negatieve scenario’s en dat is moeilijk te doorbreken omdat er emoties bij komen kijken. Wat ik misschien wel net zo verontrustend vind, zijn de mensen die er helemaal niet mee bezig zijn. Het is goed dat mensen de vrijheid hebben om zich er niets van aan te trekken. AI is echter een horizontale en alomtegenwoordige technologie. Het duikt op in redactiekamers, klinische instellingen en banken. Ik vergelijk het in dat opzicht met elektriciteit; we hebben het elektriciteitsnet allemaal nodig. Dat zal op een gegeven moment ook voor AI gelden. Net zoals we allemaal weten dat er een risico is als we een apparaat in het stopcontact steken als het nat is, moeten we onze kennis over AI vergroten.”

Heeft uw ervaring uw bezorgdheid over AI veranderd?

“Hoe meer kennis je krijgt, hoe meer je verandert. Althans, dat zou zo moeten zijn. We maken ons nog steeds zorgen over hoe AI opduikt in bijvoorbeeld rechtshandhaving, justitiële instellingen of de gezondheidszorg. Dit zijn allemaal zaken met een grote impact die ons allemaal aangaan, zowel technologen als niet-technologen. We moeten AI zien als een levenscyclus, als een lang proces van gegevens verzamelen en modellen bouwen om gegevens te ondersteunen. Op basis daarvan neemt het beslissingen en wordt AI ingezet in een specifieke context. Contexten veranderen en daarom variëren ook de potentiële gevolgen.”

In een interview dat u eerder gaf, zei u dat een van uw zorgen de verspreiding van verkeerde informatie was die het gevolg kan zijn van AI. Is dat nog steeds het geval?

“Dit is niet alleen een kwestie van AI. Sociale mediaplatforms zijn de primaire manier om content te verspreiden. Sociale media maken gebruik van AI en versterken wat wij zien als essentieel of vermakelijk. Daarom zullen ze deze inhoud algoritmisch blijven tonen. De menselijke natuur heeft een neiging naar sensationeel nieuws dat niet altijd overeenkomt met de waarheid. We moeten in staat zijn om met al deze zaken tegelijk te worstelen, dus dat is nog steeds een punt van zorg voor mij.”

Hoe kunnen we de verspreiding van verkeerde informatie voorkomen?

“De eerste stap is bewustwording en educatie; dit moeten we naar een hoger plan tillen. Dat betekent niet dat we van iedereen een datawetenschapper of een doctor in de statistiek willen maken, maar wel dat we mensen de basisbeginselen bijbrengen over hoe data in ons leven werkt, waar het opduikt en hoe het wordt gebruikt. Als je mensen kunt informeren en ze in de beste positie kunt plaatsen om zelf beslissingen te nemen, is dat een win-win situatie.

Een ander punt om over na te denken is de rol van ons technologen. We moeten bewijzen dat we het vertrouwen van onze klanten waard zijn. Onze platforms moeten betrouwbaar zijn. Daarom proberen we bij SAS zo transparant mogelijk te zijn, bijvoorbeeld door kaders aan te bieden en uitlegmogelijkheden in onze platforms in te bouwen, zodat mensen kunnen begrijpen hoe de gegevens zijn gebruikt. Ook overheden hebben een rol en we zien momenteel veel overheidsactiviteiten op het gebied van AI. Dit all-in moment vereist dat iedereen een stap voorwaarts zet.”

Wat is uw definitie van betrouwbare AI?

“Als ik het heb over betrouwbare AI, dan heb ik het over de vraag of AI al dan niet ethisch wordt gebruikt. Ik heb het over het waarborgen van voldoende transparantie en uitlegbaarheid, dus over alle ongrijpbare kenmerken die we zoeken als we het over vertrouwen hebben. Vertrouwen is een emotie, geen wiskundige vergelijking. In wetenschappelijke kringen kunnen we vertrouwen heel snel definiëren. Ik denk dat het een dwaze opdracht is; je weet wat vertrouwen is als je vertrouwen voelt. We zullen dus een aantal dingen tastbaar doen waarvan we weten dat ze vertrouwen kenmerken, maar we kunnen niemand dwingen om ons te vertrouwen. Het enige wat we kunnen doen is ons op een betrouwbare manier gedragen en dan een ander dat gevoel geven of niet.”

Hoe ziet u overheden ingrijpen om de AI-ruimte te reguleren?

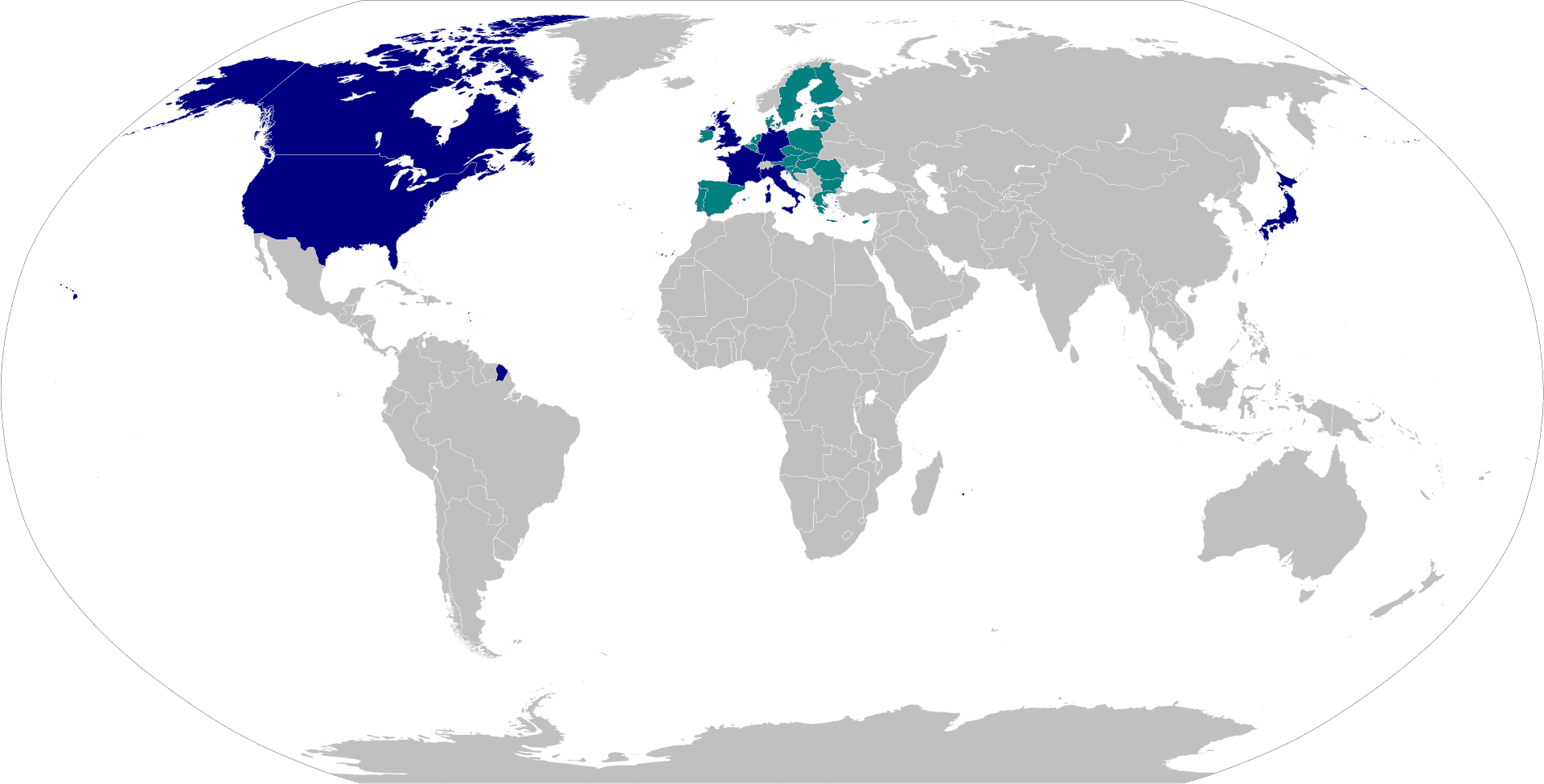

“Wat geruststellend is, is dat er een discussie gaande is. Wat ook geruststellend is, is dat de discussies leiden tot een gemeenschappelijk gevoel van doel en waarden. Verklaringen zijn geweldig. De beloften zijn fantastisch. De volgende stap is hoe we ze in de praktijk brengen, met andere woorden, hoe we onze waarden mogelijk maken. Het harde werk ligt voor ons. De EU koos voor de hard law-benadering, terwijl het VK en de VS voor de soft law-benadering kozen.”

EU-benadering vs. VS-benadering

De AI Act van de EU is een regelgevend kader voor AI in de Europese interne markt, waarbij een risicogebaseerde benadering van AI-systemen wordt vastgesteld. De nadruk ligt op het respecteren van de waarden en fundamentele rechten van de EU.

De Executive Order van Biden onderstreept het Amerikaanse leiderschap bij het benutten van de kansen die AI biedt en benadrukt veiligheid, rechtvaardigheid en burgerrechten.

Een meer gedetailleerde vergelijking vindt u hier.

Sommigen geloven dat deze regelgeving de ontwikkeling van AI zal belemmeren.

“Elke regelgeving is een belemmering. Ik denk dat de echte vraag is: hebben innovators het vermogen om te innoveren? Gaan ze zo snel als ze zouden kunnen? Misschien niet, maar zouden ze dat wel moeten doen? Op een gegeven moment moeten we grenzen stellen; voor mij is de vraag: hoe breed zijn de marges? Sommige van de beste innovaties komen voort uit beperkingen, niet zonder.”

Wat zou je graag zien in de AI-ruimte over vijf jaar?

“Ik zou graag een aantal, zo niet harde, dan toch een aantal pseudo-standaarden zien die we allemaal accepteren en waar we het over eens zijn. Ik zou graag zien dat mensen meer leren over de AI-ruimte. Ik zou graag een manier zien waarop individuen meer controle krijgen over hun gegevens, zodat ze er optimaal van kunnen profiteren.”