Er zijn van die berichten op sociale media die de meeste gebruikers onmiddellijk afdoen als nepnieuws. Gelukkig weet een grote groep mensen best het kaf van het koren te scheiden. Maar naar mate de bron van de berichten betrouwbaarder lijkt, wordt het steeds moeilijker om ‘fake’ nieuws van echt te onderscheiden. Daar lijken nu wetenschappers van de universiteiten van Göttingen en Frankfurt en het Jožef Stefan Instituut in Ljubljana een antwoord op gevonden te hebben.

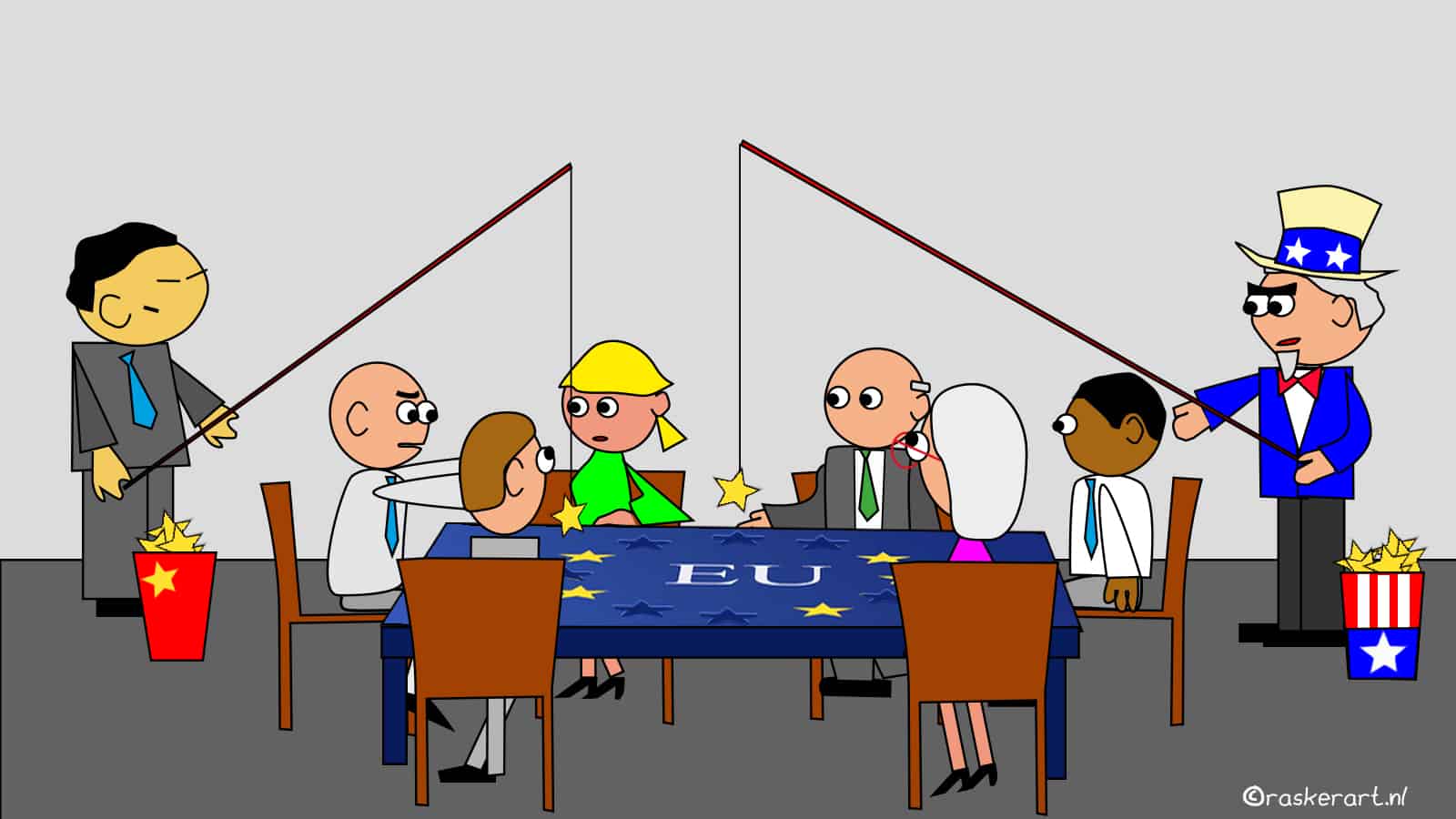

De gebeurtenissen in de Verenigde Staten van de afgelopen maanden hebben duidelijk gemaakt dat zelfs de democratie gevaar kan lopen als mensen het onderscheid niet meer weten te maken tussen echt nieuws en onware berichten. Er dreigen echter nog andere gevaren. Zo verspreiden criminelen steeds vaker nepnieuws over bedrijven, om zo de aandelenkoersen te manipuleren.

Taalkundige kenmerken

De Duitse en Sloveense onderzoekers hebben een aanpak ontwikkeld die dergelijk nepnieuws kan herkennen. Zelfs wanneer de nieuwsinhoud herhaaldelijk wordt aangepast. De resultaten van het onderzoek zijn gepubliceerd in het Journal of the Association for Information Systems.

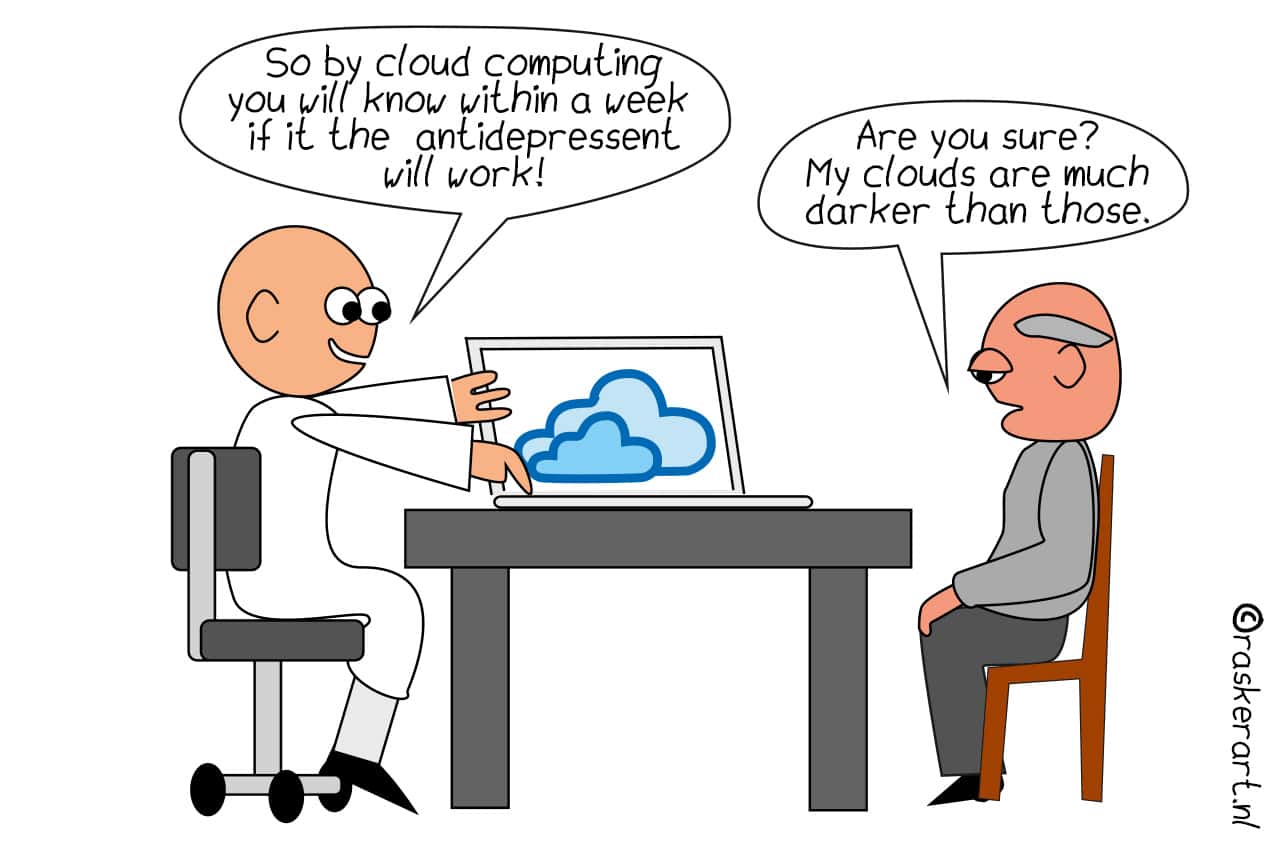

Criminelen verspreiden op social media fictieve gegevens die een bepaald bedrijf in een positief daglicht stellen. Om die berichten op te sporen, maakten de wetenschappers gebruik van machine learning-methoden. Ze ontwikkelden taalmodellen waarmee verdachte berichten ontdekt kunnen worden op basis van hun inhoud en bepaalde taalkundige kenmerken.

“Hierbij kijken we naar andere aspecten van de tekst waaruit het bericht bestaat, zoals de begrijpelijkheid van de taal en de stemming die de tekst overbrengt,” legt professor Jan Muntermann van de universiteit van Göttingen uit. De aanpak is in principe al bekend door het gebruik ervan door bijvoorbeeld spamfilters. Het belangrijkste probleem met de huidige methoden is echter dat fraudeurs voortdurend de inhoud aanpassen en bepaalde woorden vermijden die worden gebruikt om nepnieuws te identificeren.

Tussen de regels door

Dit is waar de nieuwe aanpak van de onderzoekers om de hoek komt kijken. De nieuwe modellen lezen als het ware tussen de regels door. Zo kan op basis van de samenstelling van de tekst toch geconcludeerd worden dat het bij een bepaald bericht om nepnieuws gaat.

“Dus zelfs als ‘verdachte’ woorden uit de tekst verdwijnen, wordt het nepnieuws nog steeds herkend aan de hand van de taalkundige kenmerken. Dit plaatst oplichters voor een dilemma. Ze kunnen alleen ontdekking voorkomen als ze de sfeer van de tekst veranderen. Bijvoorbeeld door het van positief naar negatief om te schrijven,” legt onderzoeker Michael Siering uit. “Maar dan schieten ze hun doel voorbij, bij hun pogingen om beleggers ertoe te brengen bepaalde aandelen te kopen.”

De nieuwe methode kan bijvoorbeeld worden gebruikt bij het toezicht op de beurshandel. Zo kan bij het ontdekken van valse berichten de handel in bepaalde aandelen tijdelijk worden stilgelegd. Bovendien biedt het beleggers waardevolle informatie om te voorkomen dat ze in dergelijke oplichtingspraktijken trappen.

Ook interessant: Kunstmatige intelligentie ontmaskert ‘fake’-reclame