Samenwerkingsverband Mindlabs gaat zich richten op de menselijke interactie met artificiële intelligentie (AI). Maar volgens professor Max Louwerse is het een misvatting om te denken dat de focus ligt op de ethische vraagstukken. “Ook in de landelijke discussie lijkt AI en ethiek hetzelfde onderzoeksdomein te worden. Dat vind ik jammer en potentieel zelfs gevaarlijk.”

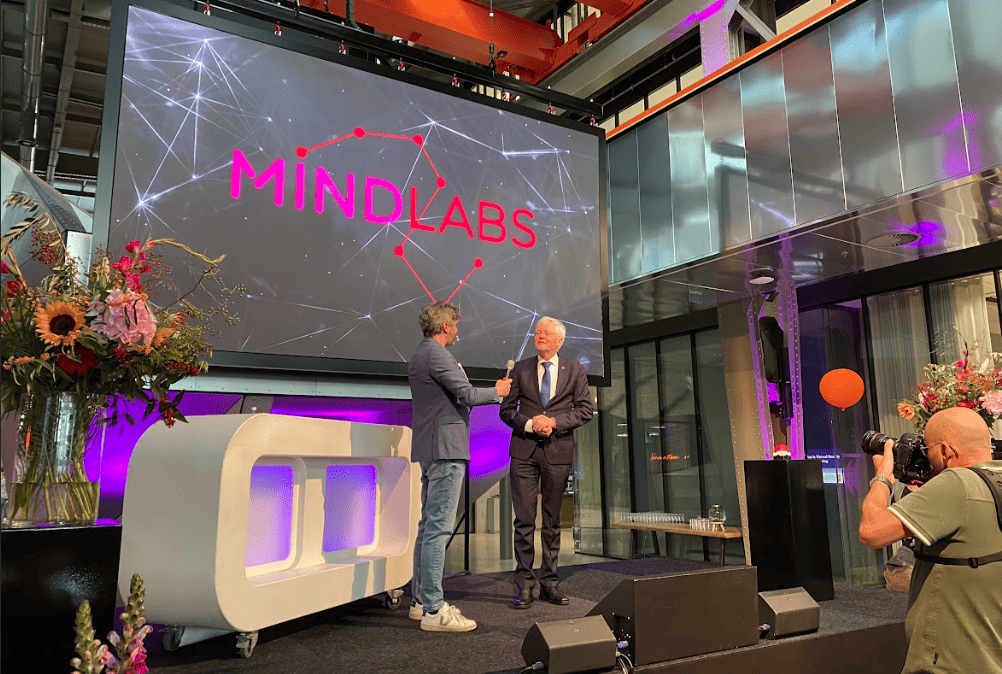

MindLabs

Louwerse is hoogleraar cognitieve psychologie en kunstmatige intelligentie aan Tilburg University. Met zijn vakgroep Cognitive Science & Artificial Intelligence en een Bachelor- en Masteropleiding kunstmatige intelligentie is hij namens de universiteit vertegenwoordigd binnen MindLabs. Dit initiatief, waarin Tilburg University samenwerkt met Fontys Hogescholen, ROC Tilburg en bedrijven, wil in de Tilburgse Spoorzone een hotspot op het gebied van AI creëren. Louwerse is één van de mede-oprichters. “Vol trots heb ik mee mogen bouwen aan de Jheronimus Academy of Data Science, maar het zat mij dwars dat veel datawetenschappers soms te weinig naar de achterliggende mechanismen van de technologie kijken.”

“Als je bijvoorbeeld het aantal ongelukken met zelfrijdende auto’s wilt terugdringen, moet je zien te achterhalen waarom die in de eerste instantie plaatsvinden.” En dat heeft volgens Louwerse alles te maken met de menselijke interactie met de technologie. “Zo ontstond vanuit de universiteit het idee om te kijken naar de combinatie tussen interactieve technologieën en menselijk gedrag. Een combinatie tussen kunstmatige intelligentie, cognitiewetenschappen, maar ook data science”

Virtuele mensen

Het is een enorme misvatting om te denken dat Mindlabs zich slechts op de ethische kanten van AI werpt, legt Louwerse uit. “Wij ontwikkelen technologie en kijken hoe die samengaat met het gebruik ervan. Bijvoorbeeld ontwikkelen we binnen ons avatars-project VIBE virtuele mensen. Daarin zijn we met name geïnteresseerd hoe die virtuele mens er levensecht uitziet, maar ook levensecht praat, denkt, en zich gedraagt. Bovendien kan die avatar verder ontwikkeld worden door gebruik te maken van de interactie met de gebruiker. Dus stel dat jij met een virtueel mens praat, dan leert het beter te praten door dat gesprek.”

AI-golf

Het is een enorme misvatting om te denken dat Mindlabs zich slechts op de ethische kanten van AI werpt, legt Louwerse uit. “Wij ontwikkelen technologie en kijken hoe die samengaat met het gebruik ervan. Bijvoorbeeld ontwikkelen we binnen ons avatars-project VIBE virtuele mensen. Daarin zijn we met name geïnteresseerd hoe die virtuele mens er levensecht uitziet, maar ook levensecht praat, denkt, en zich gedraagt. Bovendien kan die avatar verder ontwikkeld worden door gebruik te maken van de interactie met de gebruiker. Dus stel dat jij met een virtueel mens praat, dan leert het beter te praten door dat gesprek.”

Gevaarlijk

De hoogleraar ziet dat het onderwerp ook op landelijk niveau wordt verward met de ethische discussie. “Ik hoor vaak kunstmatige intelligentie en ethiek in één adem genoemd worden. In de landelijke discussie lijkt AI en ethiek hetzelfde onderzoeksdomein te worden. Natuurlijk spelen ethische kwesties altijd een belangrijke rol, maar dit voor kunstmatige intelligentie niet anders dan voor andere wetenschapsgebieden. Ik vind het jammer en potentieel zelfs gevaarlijk, omdat het de ontwikkelingen kan belemmeren.”

“We kunnen die ontwikkelingen binnen Nederland en Europa afremmen omdat we bijvoorbeeld willen dat de privacy goed geregeld is. Daar ben ik ook een groot voorstander van, maar de ontwikkelingen vanuit de VS en China gaan ondertussen gewoon door. Ik vind dat je niet je hoofd in het zand moet steken, maar vanuit wetenschappelijk oogpunt juist zo veel mogelijk met die ontwikkelingen mee moet gaan. Het staat daarbij buiten kijf dat dat binnen alle ethische kaders gebeurt. Maar hoe de techniek uiteindelijk toegepast gaat worden is een ethisch vraagstuk waar de regering zich over mag buigen.”

“Vanuit wetenschappelijk perspectief wil in elk geval de technologie blijven begrijpen. Ik vrees dat die ontwikkelingen in Europa soms wel eens worden overstemd door de discussie rondom ethiek. Terwijl ik zelden ontwikkelingen op het gebied van de computationele taalkunde overstemd hoor worden door een discussie rondom ethiek. Terwijl ethiek daar even belangrijk is.”

Killer drones

Maar is het niet veel te laat om achteraf pas te kijken naar de ethische objecties? Volgens Louwerse is dat geen valide argument. “Kijk bijvoorbeeld naar de discussie rondom autonome drones, die kunnen worden gebruik voor oorlogsdoeleinden. Als maatschappij kun je zeggen dat we dat absoluut niet willen. Maar als wetenschapper ben ik geïnteresseerd in het begrijpen van de technologie, zodat we die drones voor de juiste doeleinden kunnen gebruiken. Denk bijvoorbeeld aan het uitschakelen van vijandelijke drones, of nog beter, voor het droppen van voedselpakketten in rampgebieden. Het ontwikkelen van kennis kan altijd voor verkeerde doeleinden worden gebruikt. Dat kun je nooit volledig overzien. Zo kan AI ook voor zowel goede als slechte doeleinden worden gebruikt. Wie ben ik dan om te zeggen dat we dit niet kunnen doorzetten?

“Voor alle duidelijkheid: ik propageer absoluut niet om de ethische vragen te laten vallen”, benadrukt de professor ten slotte. “En ook zeker niet om gevaarlijke drones te ontwikkelen. Ik wil ons als maatschappij er slechts bewust van maken dat we altijd moeten investeren in kennis. Wat je met die kennis doet heb je vervolgens zelf in de hand.”